Het Model Context Protocol (MCP) is een open standaard, in november 2024 gelanceerd door Anthropic, die standaardiseert hoe AI-applicaties verbinding maken met externe tools, databases en diensten. MCP vervangt losse maatwerk-koppelingen door één universeel protocol, vergelijkbaar met hoe HTTP het web standaardiseerde.

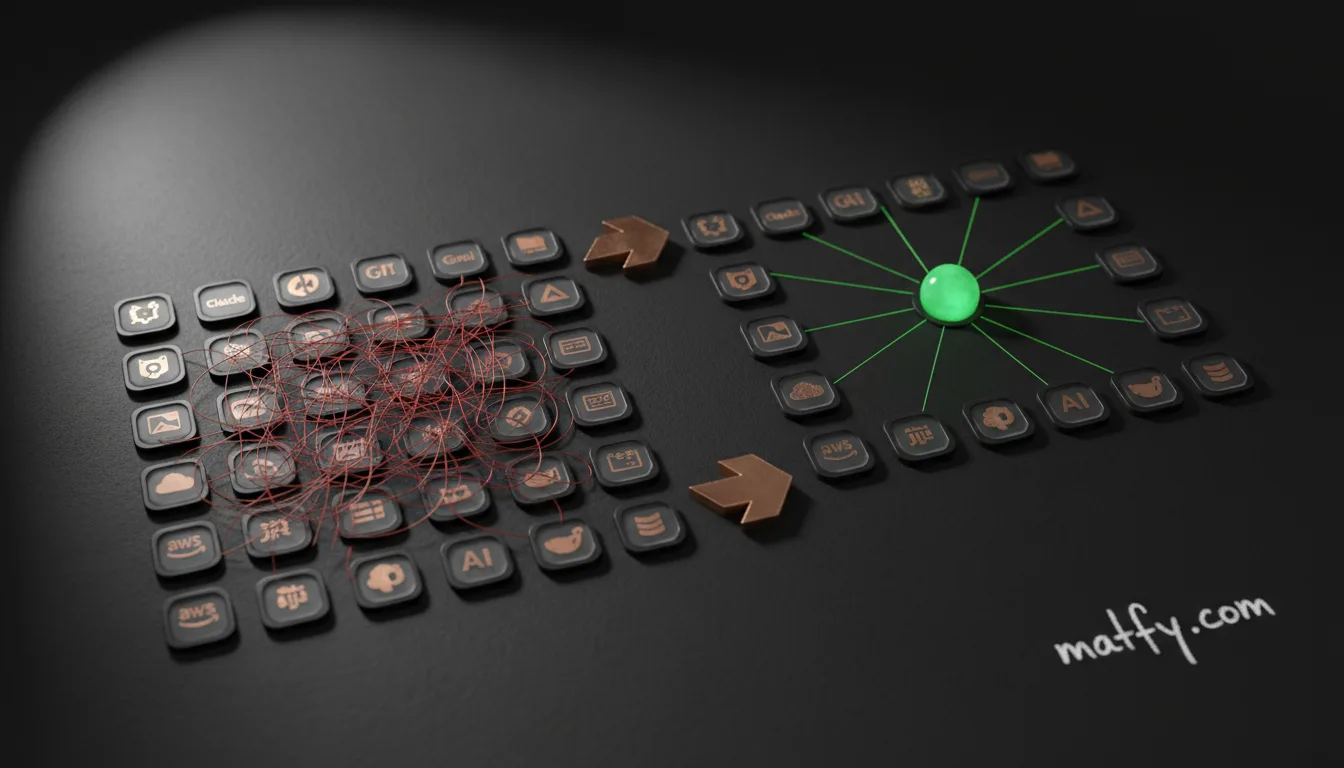

Vóór MCP moest elke combinatie van AI-model en extern systeem een aparte custom integratie hebben. Elke API anders, elke authenticatie anders, elke datastructuur anders. Schaalbaar is dat niet. En terwijl er steeds meer AI-modellen en tools kwamen, werd het probleem groter.

Het resultaat: downloads groeiden van 100.000 in november 2024 naar 97 miljoen per maand eind 2025, een groei van 970x (Future Forem, 2025). Dat is geen geleidelijke adoptie, dat is een sneeuwbal. OpenAI en Microsoft adopteerden het protocol al in 2025. Maar wat is MCP precies en wat kun je er in de praktijk mee?

TL;DR: Het Model Context Protocol (MCP) is de open standaard die regelt hoe AI-modellen praten met externe tools en data. Downloads groeiden in één jaar van 100.000 naar 97 miljoen per maand (Future Forem, 2025). Zowel OpenAI als Microsoft adopteerden MCP in 2025, waarmee het de de facto industriestandaard voor AI-integraties werd.

Waarom is MCP ontstaan en hoe lost het het M×N-probleem op?

GPT-4 heeft een trainingsdata-cutoff van april 2023 (OpenAI officieel). Zonder externe tools is elk AI-model bevroren in het verleden: het weet niets van je eigen bestanden, je GitHub-repos of actuele webdata. De oplossing leek simpel: verbind AI-modellen met externe tools via APIs. Maar dat pakt snel ingewikkeld uit.

Stel: je hebt vijf AI-modellen (Claude, GPT, Gemini, enzovoort) en tien externe tools (GitHub, Slack, Google Drive, enzovoort). Zonder standaard zijn er theoretisch 50 verschillende integraties nodig. Dat is het M×N-probleem dat de officiële MCP-documentatie (modelcontextprotocol.io) beschrijft. Met MCP zijn het er vijftien: vijf modellen plus tien tools, allemaal via één protocol.

| Scenario | Vóór MCP | Met MCP |

|---|---|---|

| 5 modellen × 10 tools | 50 custom integraties nodig | 15 verbindingen (5 + 10) |

| Nieuw AI-model toevoegen | 10 integraties opnieuw bouwen | Één MCP-compatibele verbinding |

| Nieuwe tool toevoegen | Voor elk model apart bouwen | Één MCP-server, werkt voor alle modellen |

| AI-model uitwisselen | Alle integraties herbouwen | MCP-servers werken met elk compatibel model |

David Soria Parra, software-engineer bij Anthropic en medeontwerper van MCP, verwoordt het kernidee raak: "MCP is het USB-C-moment voor AI-integraties. Vóór MCP had elk team zijn eigen aanpak. Nu bouwen we één server en die werkt voor alle AI-modellen." (Anthropic YouTube, 2025)

De USB-C-analogie klopt. Vóór USB-C had je USB-A, mini-USB, micro-USB en Lightning: elke fabrikant zijn eigen kabel. Vóór MCP had je OpenAI function calling, LangChain tools, Anthropic computer use en een waslijst aan custom API-wrappers. De chaos is hetzelfde. De oplossing ook: één gedeelde standaard die iedereen adopteert.

Dat is waar MCP op inzet. Niet sneller of slimmer dan bestaande integraties, maar de complexiteit wegsnijden door standaardisatie. Één protocol dat elk AI-model begrijpt en dat voor elke externe tool werkt.

Hoe is MCP opgebouwd en wat zijn de drie lagen van de architectuur?

MCP communiceert via JSON-RPC 2.0 berichten en ondersteunt drie transportmodi: stdio voor lokale servers, Server-Sent Events (SSE) en HTTP voor remote servers (MCP officiële specificatie, modelcontextprotocol.io). De architectuur heeft drie componenten die elk een eigen rol spelen.

De MCP Host is de AI-applicatie die je als gebruiker kent. Claude Desktop is de meest bekende host, maar ook IDE's zoals Cursor en Windsurf zijn MCP-hosts. De host beheert de verbindingen naar alle MCP-servers en bepaalt welke servers beschikbaar zijn tijdens een gesprek.

De MCP Client is een ingebouwde component binnen de host. De client onderhoudt één verbinding per server en handelt de communicatie af. De gebruiker merkt er niets van: het is de motor onder de motorkap die ervoor zorgt dat verzoeken op de juiste plek terechtkomen.

De MCP Server is het externe programma dat functionaliteiten beschikbaar stelt. Een GitHub MCP-server geeft de AI toegang tot je repositories. Een Filesystem-server geeft toegang tot lokale bestanden. Een Brave Search-server geeft realtime toegang tot webzoekopdrachten. Elke server heeft één taak en doet die goed.

Een concreet voorbeeld: je vraagt in Claude Desktop om alle open issues in je GitHub-repo. Claude herkent dat de GitHub MCP-server relevant is, stuurt een tool-aanroep via de client, de server authenticeert via een Personal Access Token, haalt de issues op bij de GitHub API en retourneert de gestructureerde data terug aan Claude. Jij ziet het als een vloeiend antwoord in de chat.

Transport: lokaal of remote?

De keuze voor transportmodus hangt af van hoe de server draait. Voor de meeste desktop-use cases begin je met stdio: de host en server communiceren via standaardinvoer en -uitvoer. Geen netwerk, geen open poorten, alles lokaal op je machine.

| Transportmodus | Gebruik | Typisch scenario |

|---|---|---|

| stdio | Lokale servers | Claude Desktop met Filesystem of GitHub MCP Server |

| SSE (Server-Sent Events) | Remote servers met streaming | Shared infrastructure, web-gebaseerde hosts |

| HTTP | Remote servers, request/response | API-achtige integraties in productieomgevingen |

SSE en HTTP zijn geschikt als je MCP wil integreren in een webomgeving of op shared infrastructure. Als je begint, is stdio wat je gebruikt. Het is het minst complex en werkt direct met Claude Desktop zonder extra configuratie.

Wat zijn de drie MCP-primitieven?

Elke MCP-server biedt drie typen functionaliteiten aan. Dit onderscheid bepaalt hoe een AI-model interacteert met een server en wat het ermee kan doen (MCP officiële specificatie, modelcontextprotocol.io).

Tools zijn uitvoerbare functies die de AI actief kan aanroepen: een bestand lezen, een zoekopdracht uitvoeren, een database queryen of een GitHub-issue aanmaken. De AI neemt een beslissing om ze te gebruiken en stuurt een verzoek. Een GitHub MCP-server biedt tools als list_issues, create_pull_request en search_code. In de praktijk zijn Tools de meest gebruikte primitief, omdat ze de AI in staat stellen om iets te doen in de wereld.

Resources zijn databronnen waartoe de AI toegang heeft voor extra context: bestanden, database-records, API-responses. Resources zijn passief: de AI leest de data maar voert geen actie uit op de bron zelf. Ze worden gebruikt om de context van een gesprek te verrijken zonder dat de AI iets aan de bron verandert.

Prompts zijn voorgedefinieerde instructiesjablonen voor specifieke workflows. Een server kan standaard-prompts aanbieden voor terugkerende taken, zoals het analyseren van een codebestand op beveiligingsproblemen of het genereren van een PR-beschrijving op basis van een diff. Prompts zorgen voor consistentie over meerdere sessies heen.

| Primitief | Beschrijving | Praktijkvoorbeeld | AI-gedrag |

|---|---|---|---|

| Tools | Uitvoerbare functies | GitHub issue aanmaken, database queryen | Actief: AI roept de functie aan |

| Resources | Databronnen voor context | Bestand lezen, API-response ophalen | Passief: AI leest, verandert niets |

| Prompts | Instructiesjablonen | Code review template, PR-beschrijving | Structuur: biedt consistente instructies |

Het onderscheid tussen Tools en Resources is subtiel maar belangrijk bij het bouwen van een eigen MCP-server. Wil je dat de AI actie kan ondernemen, gebruik dan Tools. Wil je de AI alleen voorzien van informatie als context, gebruik dan Resources. Prompts zijn het minst bekend maar nuttig zodra je workflows standaardiseert over een team heen.

MCP in de praktijk: AI agents verbinden met databases en APIs

Wat kun je vandaag al doen met MCP?

Dit is waar het concreet wordt. De meeste bronnen blijven hangen op architectuurniveau. De interessantere vraag is wat je er nu mee kunt doen. Het officiële MCP-register bevat per februari 2026 meer dan 6.400 gepubliceerde servers (The Next Web, februari 2026). Dat zijn geen experimenten, dat is een ecosysteem.

Drie praktische use cases die je vandaag met Claude Desktop kunt uitproberen:

GitHub MCP Server: Verbind Claude direct met je GitHub-repositories. Vraag Claude om alle open issues te tonen, een PR-beschrijving te schrijven op basis van je laatste commit, of een specifieke functie te zoeken door je hele codebase. Resultaat: je volledige GitHub-workflow via gewone conversatie, zonder de browser te openen voor elke stap.

Filesystem MCP Server: Geef Claude toegang tot een map op je lokale computer. Vraag Claude om alle markdown-bestanden in je projectmap samen te vatten, specifieke code te vinden, of twee configuratiebestanden te vergelijken. Resultaat: Claude als lokale zoek- en samenvattingsassistent voor je eigen bestanden, zonder één keer te kopiëren en plakken.

Brave Search MCP Server: Geef Claude realtime toegang tot webzoekopdrachten buiten zijn trainingsdata. Vraag Claude om het laatste nieuws over een technologie op te zoeken, actuele prijsvergelijkingen te maken, of te checken of een library nog actief wordt onderhouden. Resultaat: Claude die antwoordt op basis van actuele webdata in plaats van informatie van maanden geleden.

Naast deze drie zijn er community-gebouwde servers voor Notion, Google Drive, Slack, PostgreSQL, Playwright (browser-automatisering) en tientallen andere tools. De meeste installeer je in Claude Desktop via een configuratiebestand van minder dan tien regels.

MCP integreert ook goed met bestaande workflow-automatiseringstools. n8n heeft native MCP-ondersteuning, waardoor je MCP-servers kunt inbedden in grotere automatiseringsflows zonder alles zelf te bouwen. Zo zet je AI agents in als onderdeel van een bredere automatisering, zonder de architectuur van scratch te hoeven ontwerpen.

Dat is het verschil met hoe MCP een jaar geleden aanvoelde: een interessant experiment voor early adopters. Nu is het infrastructuur. Meer dan 10.000 gepubliceerde servers eind 2025 (Thoughtworks Technology Radar, 2025), van developer tools tot Fortune 500-implementaties. Je hoeft niet meer alles zelf te bouwen.

Waarom wordt MCP de industriestandaard?

Anthropic lanceerde MCP als open-source standaard in november 2024 (Anthropic officieel). Open-source alleen maakt nog geen standaard. Wat MCP tot de de facto standaard maakt, is wat er sindsdien is gebeurd.

In 2025 breidde OpenAI hun Agent SDK uit met volledige MCP-ondersteuning (OpenAI Agent SDK documentatie, 2025). OpenAI is de grootste concurrent van Anthropic. Als zij een protocol van een concurrent adopteren, is er iets aan de hand. Alex Albert van Anthropic Developer Relations vatte het samen in de officiële MCP-presentatie: "MCP is al door andere AI-labs geadopteerd. OpenAI gebruikt het nu ook in hun Agent SDK. Dat is het moment waarop je weet dat het een echte standaard wordt en geen Anthropic-experiment."

Microsoft volgde in december 2025 met officiële MCP-integratie in Windows AI, inclusief volledige documentatie op Microsoft Learn (Microsoft Learn, december 2025). Enterprise-adoptie op het hoogste niveau, met het volledige gewicht van het Microsoft-ecosysteem erachter.

De USB-C-vergelijking houdt hier stand. Vóór USB-C koos elke fabrikant zijn eigen connector totdat Apple, Google en Samsung het eens werden. Bij MCP liep dat proces in twaalf maanden. Twee van de grootste techbedrijven ter wereld kozen voor hetzelfde protocol, en elk ander platform dat AI-integraties bouwt, heeft nu een reden om hetzelfde te doen.

AI-referred web sessions groeiden met 527% tussen januari en mei 2025 (SparkToro, 2025). In dat landschap is standaardisatie van AI-integraties geen nice-to-have. Het is infrastructuur voor wie serieus met AI werkt.

Hoe verschilt MCP van traditionele API-integratie?

Een veelgestelde vraag: vervangt MCP dan gewone API-integraties? Nee. MCP voegt een standaardisatielaag toe boven op bestaande APIs. De GitHub MCP-server gebruikt intern nog steeds de GitHub REST API, maar jij hoeft die niet meer zelf te integreren per AI-model dat je gebruikt.

Implementatie met MCP kan de hoeveelheid benodigde custom integratiecode met tot 70% verminderen vergeleken met maatwerk API-koppelingen (gerapporteerd voordeel, PromptLayer MCP guide). De winst zit niet in snellere calls of betere performance, maar in onderhoudskosten en uitwisselbaarheid van AI-modellen.

| Eigenschap | Traditionele API-integratie | Met MCP |

|---|---|---|

| Aantal te bouwen verbindingen | M × N (per model per tool) | M + N (één protocol) |

| Authenticatie | Per integratie custom | Gestandaardiseerd per server |

| Onderhoudskosten | Hoog: elke API-wijziging kan integraties breken | Lager: alleen de MCP-server bijwerken |

| AI-model uitwisselen | Alle integraties herbouwen | MCP-servers werken met elk compatibel model |

| Ecosysteem-support | Zelf bouwen of vendor-specifiek | 6.400+ kant-en-klare servers beschikbaar |

De keuze is niet binair. Bij eenvoudige integraties voor één AI-model is een directe API-koppeling vaak sneller en eenvoudiger. Maar als je meerdere modellen gebruikt, meerdere tools nodig hebt, of regelmatig van AI-model wil kunnen wisselen, betaalt MCP zich terug in minder code en minder onderhoud.

Wanneer gebruik je MCP beter niet?

Even eerlijk zijn, want dat ontbreekt in de meeste uitleggen. MCP is niet altijd het antwoord. Er zijn situaties waarin een directe API-integratie simpelweg beter past.

Als je één specifieke integratie bouwt die nooit hoeft te schalen naar andere AI-modellen, is een directe API-koppeling sneller en eenvoudiger. Geen extra abstractielaag, geen MCP-configuratie, gewoon de API aanspreken en klaar. Soms lost een directe koppeling van twintig euro per maand het gewoon op, en dan hoef je geen protocol-architectuur te bouwen.

MCP heeft ook een leercurve. Je moet begrijpen hoe servers geconfigureerd worden via JSON-bestanden, hoe je omgaat met authenticatie en API-sleutels in het configuratiebestand, en wat je doet als een server crasht. Niet onoverkomelijk, maar ook niet nul configuratie.

Een derde overweging: niet alle MCP-servers zijn even stabiel. Het ecosysteem groeit snel en sommige community-gebouwde servers zijn experimenteel. In productiegebruik is het verstandig om te kiezen voor servers die actief onderhouden worden en een trackrecord hebben. Kijk naar update-frequentie en open issues voordat je een community-server in een kritisch systeem gooit.

De praktische vuistregel: gebruik MCP als je meerdere AI-modellen wilt ondersteunen, meerdere tools nodig hebt, of wilt bouwen op een ecosysteem van bestaande servers. Gebruik een directe API als je één simpele integratie bouwt die stabiel moet zijn en nooit hoeft te schalen.

De eerste vraag bij elk AI-project blijft: wat wil je bereiken? Als het antwoord is "mijn AI agent verbinden met vijf externe systemen die ook andere modellen moeten kunnen gebruiken", is MCP de juiste keuze. Als het antwoord is "één specifieke koppeling bouwen die drie jaar stabiel moet draaien", overweeg dan of de extra laag je iets oplevert.

Veelgestelde vragen over MCP

Wat is een MCP-server?

Een MCP-server is een lichtgewicht programma dat specifieke functionaliteiten beschikbaar stelt aan AI-modellen. De server fungeert als brug tussen het AI-model en een extern systeem, zoals GitHub, Google Drive of een database. De AI stuurt verzoeken naar de server via het MCP-protocol; de server voert de actie uit en retourneert het resultaat terug aan het model.

Hoe verschilt MCP van een normale API?

Een API is een interface van één specifieke dienst die je per AI-model apart moet integreren. MCP is een universeel protocol dat één verbindingsstandaard biedt voor alle AI-modellen. Één MCP-server voor GitHub werkt met Claude, GPT en elke andere MCP-compatibele AI, zonder extra integratiecode te schrijven. MCP zit als protocol bovenop bestaande APIs.

Werkt MCP alleen met Claude?

Nee. MCP is een open standaard die werkt met elke AI-applicatie die het protocol implementeert. OpenAI heeft MCP-ondersteuning toegevoegd aan hun Agent SDK in 2025 en Microsoft heeft het geïntegreerd in Windows AI. MCP is ontworpen als model-agnostisch universeel protocol, vergelijkbaar met hoe HTTP werkt onafhankelijk van welke browser je gebruikt.

Hoe installeer ik een MCP-server in Claude Desktop?

Open Claude Desktop en ga naar Instellingen. Installeer een server vanuit de Anthropic-gereviewde directory, of voeg een custom server toe via het configuratiebestand claude_desktop_config.json. Definieer de server met naam, commando en eventuele API-sleutels. Na een herstart van Claude Desktop verschijnen de MCP-tools automatisch in je gesprekken, zonder verdere configuratie.

Wat is het verschil tussen MCP Host, Client en Server?

De Host is de AI-applicatie die je gebruikt: Claude Desktop, Cursor IDE of een custom app. De Client is de ingebouwde component in de host die verbindingen beheert. De Server is het externe programma dat functionaliteiten aanbiedt, zoals GitHub-toegang, webzoekopdrachten of bestandsbeheer. Host is je app, Client is de verbindingsbeheerder, Server is de tool die iets kan doen.

Conclusie

MCP is geen hype. Het lost een echt, concreet probleem op: de kakofonie van losse, incompatibele AI-integraties die elk afzonderlijk moesten worden gebouwd en onderhouden. Het M×N-probleem is reëel, en MCP is de meest pragmatische oplossing die breed geadopteerd is.

Dat OpenAI en Microsoft het protocol adopteerden, laat zien dat dit geen Anthropic-experiment is maar een open industriestandaard. Een standaard die het waard is om te kennen, ook als je er vandaag nog niets mee bouwt.

De meeste mensen die nu beginnen met MCP doen dat via Claude Desktop en een paar veelgebruikte servers: GitHub, Filesystem, Brave Search. Dat is een prima startpunt. Van daaruit kun je uitbreiden naar complexere setups, eigen MCP-servers bouwen in Python of TypeScript, of MCP inzetten als basis voor bredere workflow-automatisering in tools als n8n.

Maar begin met de vraag: wat wil je bereiken? MCP is een krachtige infrastructuurlaag. Gebruik het waar het past, niet omdat het de nieuwste technologie is. MCP geeft AI agents ook het vermogen om te handelen in de wereld. Meer over hoe AI agents werken en hoe MCP daarin past, vind je in het overzicht over AI agents en AI-automatisering.

AI Agent Builder. Bouwt AI agents en agentic systems voor Nederlandse bedrijven bij MBWorkers. Deelt op Matfy wat hij tegenkomt in de wereld van AI.