Risico-inventarisatie voor AI: zo doe je het

Een advocatenkantoor in de VS kreeg in 2023 een boete opgelegd nadat zijn AI-tool zes volledig verzonnen rechtszaken als precedent had geciteerd in een officieel document. De rechter was niet onder de indruk. Het kantoor had geen enkel proces om de output van het systeem te controleren, geen verantwoordelijke aangewezen, en geen idee dat dit risico bestond. Dat is precies wat een risico inventarisatie en evaluatie voor AI voorkomt: niet de technologie zelf, maar de gaten in je eigen organisatie.

Belangrijkste punten:

- Een risico inventarisatie en evaluatie (RI&E) is wettelijk verplicht voor elk bedrijf met personeel, en AI-systemen vallen daar expliciet onder als ze arbeidsomstandigheden, besluitvorming of veiligheid beïnvloeden.

- AI-specifieke risico's zoals modelfouten, datavergiftiging en autonome beslissingen vereisen een andere aanpak dan klassieke arborisico's, maar dezelfde systematische structuur.

- De EU AI Act legt vanaf augustus 2026 aanvullende verplichtingen op voor hoog-risico AI-systemen, waaronder verplichte risicobeheersystemen en documentatie.

- Een AI-RI&E hoeft niet ingewikkeld te zijn: een gestructureerde checklist van zes stappen geeft de meeste bedrijven al een werkbaar beeld van hun blootstelling.

Inhoudsopgave

- Wat is een risico inventarisatie en evaluatie, en waarom geldt het ook voor AI?

- Welke AI-risico's moet je inventariseren?

- Wanneer is een AI-systeem hoog-risico?

- Zo stel je een AI risico inventarisatie en evaluatie op: zes stappen

- Wat zijn de gevolgen als je dit niet doet?

- Hoe verhoudt een AI-RI&E zich tot een DPIA?

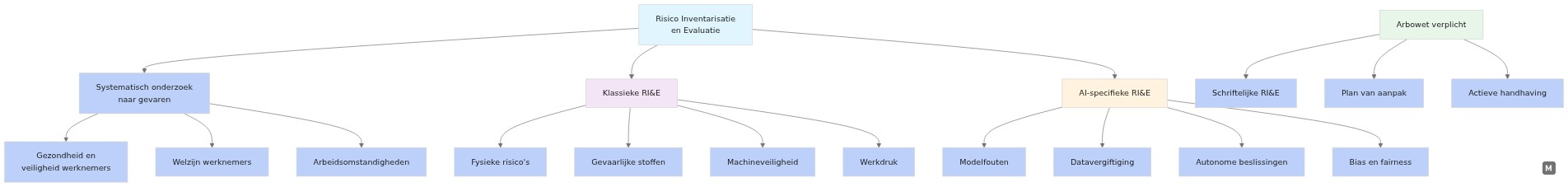

Wat is een risico inventarisatie en evaluatie, en waarom geldt het ook voor AI?

Een risico inventarisatie en evaluatie is een systematisch onderzoek naar alle gevaren binnen een bedrijf die de gezondheid, veiligheid of het welzijn van werknemers kunnen beïnvloeden. Een AI-RI&E is een risico inventarisatie en evaluatie die specifiek de gevaren van AI-systemen in kaart brengt: van modelfouten en bias tot aansprakelijkheid en privacyrisico's. Volgens de Arbowet is iedere werkgever met personeel verplicht een schriftelijke RI&E op te stellen, inclusief een plan van aanpak. De Nederlandse Arbeidsinspectie handhaaft dit actief en kan direct een boete opleggen als de RI&E ontbreekt of onvolledig is.

De klassieke RI&E richt zich op fysieke risico's: gevaarlijke stoffen, machineveiligheid, werkdruk. Maar de Arbowet is technologieneutraal. Als jij een AI-systeem inzet dat beslissingen neemt over medewerkers, klanten of veiligheid, dan vallen de risico's van dat systeem gewoon onder je arbobeleid.

Daar bovenop komt de EU AI Act, die verboden op onaanvaardbare AI-toepassingen per 2 februari 2025 heeft laten ingaan. Voor hoog-risico systemen, zoals AI die personeelsbeslissingen ondersteunt of kredietbeoordelingen uitvoert, gelden vanaf augustus 2026 verplichte risicobeheersystemen en documentatieverplichtingen. De RI&E en de AI Act overlappen op dit punt: beide vragen je om risico's te identificeren, te beoordelen en te beheersen.

Welke AI-risico's moet je inventariseren?

Een AI-RI&E inventariseert vijf hoofdcategorieën: modelfouten en hallucinaties, datavergiftiging, autonome beslissingen zonder toezicht, algoritmische bias, en privacy- en datalekkagerisico's. Elk van deze risico's kan leiden tot aansprakelijkheid, AVG-schending of reputatieschade, ook als je geen eigen modellen bouwt.

De meeste RI&E-instrumenten zijn ontworpen voor fysieke arbeidsrisico's. AI voegt een nieuwe categorie toe. Hieronder de vijf risicotypen die in elke AI-RI&E thuishoren.

Modelfouten en hallucinaties. AI-modellen produceren soms feitelijk onjuiste output met grote zekerheid. Het advocatenkantoor-voorbeeld is geen uitzondering: een middelgroot handelsbedrijf baseerde inkoopbeslissingen op AI-marktanalyses die fictieve geopolitieke ontwikkelingen bevatten, met significante financiële verliezen als gevolg. Het risico zit niet in de fout zelf, maar in het ontbreken van een verificatieproces.

Datavergiftiging. Als een AI-systeem traint op externe of ongecontroleerde data, kan kwaadwillende input het model sturen richting foute uitkomsten. Volgens het NCSC is dit een reëel beveiligingsrisico voor bedrijven die eigen modellen trainen of fine-tunen. Voor de meeste ondernemers die bestaande tools gebruiken is dit minder acuut, maar bij maatwerk AI-ontwikkeling is het een serieus aandachtspunt.

Autonome beslissingen zonder toezicht. AI-systemen die zelfstandig beslissingen nemen, zoals het afwijzen van sollicitanten, het blokkeren van transacties of het plannen van onderhoud, creëren aansprakelijkheidsrisico's. Wie is verantwoordelijk als het systeem een fout maakt? Als dat antwoord niet in je organisatie belegd is, heb je een gat in je risicobeheersing.

Algoritmische bias. Modellen die getraind zijn op historische data kunnen bestaande ongelijkheden versterken. Dit is niet alleen een ethisch probleem: bij HR-beslissingen of kredietbeoordeling kan het juridische gevolgen hebben onder de AVG en de AI Act.

Privacy en datalekkage. Wanneer medewerkers bedrijfsgevoelige informatie invoeren in publieke AI-tools, denk aan contractteksten, klantgegevens of financiële cijfers, verlaat die data mogelijk de organisatie. Veel AI-diensten gebruiken ingevoerde data standaard voor modelverbetering, tenzij dit expliciet is uitgeschakeld. Dat levert AVG-risico's op en kan vertrouwelijkheidsverplichtingen schenden. Volgens Sazas is ongecontroleerd gebruik van AI-tools door medewerkers een van de meest onderschatte risico's in de praktijk.

| Risicotype | Voorbeeld | Directe impact |

|---|---|---|

| Modelfouten / hallucinaties | Onjuiste juridische of financiële adviezen | Aansprakelijkheid, reputatieschade |

| Datavergiftiging | Gemanipuleerde trainingsdata | Foutieve beslissingen op schaal |

| Autonome beslissingen | AI wijst sollicitant af zonder menselijke check | Juridische blootstelling, AVG-schending |

| Algoritmische bias | Historische data versterkt ongelijkheid | Discriminatieclaims, boetes |

| Privacy en datalekkage | Bedrijfsdata in publieke AI-tool | AVG-boetes, vertrouwensbreuk |

Wanneer is een AI-systeem hoog-risico?

Niet elk AI-systeem vereist dezelfde diepgang in je RI&E. De EU AI Act hanteert een risicogebaseerde aanpak: hoe groter de potentiële impact op mensen, hoe zwaarder de eisen.

Hoog-risico AI-systemen zijn systemen die worden ingezet in sectoren als HR, kredietbeoordeling, onderwijs, kritieke infrastructuur of rechtshandhaving. Concreet: een AI die sollicitanten rangschikt, een systeem dat creditwaardigheid beoordeelt, of een tool die medische aanbevelingen doet. Volgens de Auditdienst Rijk worden hoog-risico systemen in de praktijk vaak te laag geclassificeerd, mogelijk om administratieve lasten te vermijden. Dat is een risico op zichzelf.

Voor jouw RI&E is de praktische vraag: heeft dit AI-systeem invloed op beslissingen die de rechten, veiligheid of kansen van mensen beïnvloeden? Als het antwoord ja is, behandel het dan als hoog-risico totdat je het tegendeel kunt aantonen.

AI-systemen die je als ondernemer zelf bouwt of laat bouwen vallen zwaarder onder de AI Act dan systemen die je als eindgebruiker afneemt van een leverancier. Maar ook als eindgebruiker draag je verantwoordelijkheid voor de inzet: hoe je het systeem configureert, welke beslissingen je eraan delegeert, en of je medewerkers getraind zijn om de output kritisch te beoordelen.

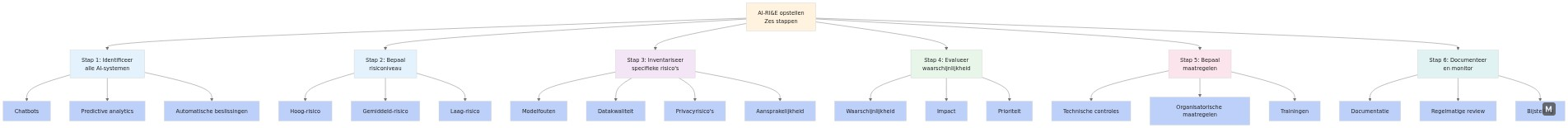

Zo stel je een AI risico inventarisatie en evaluatie op: zes stappen

Een AI-RI&E volgt dezelfde structuur als een klassieke risico inventarisatie en evaluatie, maar met aanvullende vragen per stap. Dit is geen juridisch document: het is een werkend instrument voor je organisatie.

Stap 1: Inventariseer welke AI-systemen je gebruikt. Maak een lijst van alle AI-tools in gebruik, inclusief leverancier, doel, en wie er dagelijks mee werkt. Vergeet ook de "schaduwtoepassingen" niet: medewerkers die zelf ChatGPT of andere tools gebruiken voor werktaken, zonder dat dit centraal geregeld is. Dat is ook een risico. Meer over AI-beveiliging in de praktijk lees je hier.

Stap 2: Bepaal per systeem de risicoclassificatie. Stel per tool de vragen: Welke beslissingen ondersteunt of neemt dit systeem? Wie wordt erdoor beïnvloed? Wat gebeurt er als het systeem een fout maakt? Gebruik de EU AI Act-categorieën als referentiekader.

Stap 3: Beoordeel de kans en impact van elk risico. Klassieke RI&E-methodiek: kans (hoe waarschijnlijk is dit risico?) vermenigvuldigd met impact (hoe groot zijn de gevolgen?). Voor AI voeg je een derde dimensie toe: detecteerbaarheid. Fouten die moeilijk te herkennen zijn, zoals subtiele bias in aanbevelingen, vereisen actievere monitoring dan fouten die direct zichtbaar zijn.

Stap 4: Stel beheersmaatregelen vast. Denk aan: menselijke verificatie van kritische AI-output, logging van beslissingen, periodieke audits van modelgedrag, en duidelijke escalatieprocedures als het systeem afwijkend gedrag vertoont. Bekijk ook hoe AI agents in productie beveiligd worden.

Stap 5: Leg verantwoordelijkheid vast. Wie is binnen jouw organisatie verantwoordelijk voor elk AI-systeem? Wie mag het systeem aanpassen? Wie besluit wanneer het systeem offline gaat? Zonder namen aan deze vragen te koppelen, is je risicobeheersing op papier maar niet in de praktijk. AI voor advocaten laat zien wat er misgaat als dit niet geregeld is.

Stap 6: Plan evaluatiemomenten. Een RI&E is nooit af. Volgens rie.nl moet je de RI&E aanpassen als er iets verandert in je bedrijf. Voor AI geldt dat extra sterk: modellen worden bijgewerkt, nieuwe versies introduceren nieuwe gedragingen, en het gebruik binnen je organisatie evolueert. Plan minimaal jaarlijks een review, en direct na elke significante wijziging in een AI-systeem.

Wat zijn de gevolgen als je dit niet doet?

De Nederlandse Arbeidsinspectie kan direct een boete opleggen als je geen RI&E hebt of als die onvolledig is. Dat geldt ook als AI-risico's niet gedekt zijn in een verder complete RI&E. Maar de formele boete is zelden het grootste probleem.

Het echte risico is aansprakelijkheid bij schade. Als een AI-systeem een fout maakt die leidt tot financieel verlies, discriminatie of een privacyschending, en je kunt niet aantonen dat je de risico's kende en beheersmaatregelen had getroffen, dan sta je juridisch zwak. Lawandmore wijst erop dat de AI Act expliciete documentatieverplichtingen stelt voor hoog-risico systemen, en dat toezichthouders actief gaan handhaven.

Daar bovenop komt reputatieschade. Een AI-fout die publiek wordt, treft het vertrouwen van klanten sneller dan welke juridische procedure dan ook. Een gedocumenteerde RI&E toont aan dat je als organisatie bewust omgaat met de risico's van AI, ook als er iets misgaat.

De Autoriteit Persoonsgegevens superviseert al bestaande hoog-risico AI-systemen, en verboden op onaanvaardbare toepassingen zijn per 2 februari 2025 van kracht. De handhavingscapaciteit groeit. Een incident afwachten is zelden de goedkoopste route.

Hoe verhoudt een AI-RI&E zich tot een DPIA?

Een veelgestelde vraag: is een AI-RI&E hetzelfde als een Data Protection Impact Assessment (DPIA)? Nee, maar ze overlappen op het punt van geautomatiseerde besluitvorming.

Een DPIA is verplicht onder de AVG als je grootschalig persoonsgegevens verwerkt of geautomatiseerde beslissingen neemt die significante gevolgen hebben voor mensen. Een AI-RI&E is breder: die kijkt ook naar veiligheid, modelkwaliteit, aansprakelijkheid en arbeidsomstandigheden, niet alleen naar privacy.

| Instrument | Wettelijke basis | Primaire focus | Wanneer verplicht |

|---|---|---|---|

| RI&E | Arbowet | Veiligheid en gezondheid medewerkers | Altijd, bij elk bedrijf met personeel |

| DPIA | AVG | Privacy en gegevensverwerking | Bij hoog-risico gegevensverwerking |

| AI Act conformiteit | EU AI Act | Veiligheid en transparantie van AI-systemen | Bij hoog-risico AI-systemen, vanaf aug. 2026 |

De meest efficiënte aanpak is deze drie instrumenten geïntegreerd op te stellen. Veel vragen overlappen: wie heeft toegang tot de data, welke beslissingen neemt het systeem, hoe worden fouten gedetecteerd? Door dit eenmalig

Veelgestelde vragen

Is een RI&E verplicht als je AI gebruikt in je bedrijf?

Ja. Volgens de Arbowet is iedere werkgever met personeel verplicht een RI&E op te stellen. AI-systemen die arbeidsomstandigheden, besluitvorming of veiligheid beïnvloeden vallen daar expliciet onder. De Nederlandse Arbeidsinspectie kan direct een boete opleggen als de RI&E ontbreekt of onvolledig is.

Wat is het verschil tussen een gewone RI&E en een AI-RI&E?

Een klassieke RI&E richt zich op fysieke risico's zoals gevaarlijke stoffen en werkdruk. Een AI-RI&E brengt specifieke gevaren van AI-systemen in kaart, zoals modelfouten, bias, datavergiftiging en aansprakelijkheidsrisico's. De systematische structuur is dezelfde, maar de risicocategorieën zijn anders.

Wat verandert de EU AI Act voor mijn risico-inventarisatie?

Vanaf augustus 2026 legt de EU AI Act aanvullende verplichtingen op voor hoog-risico AI-systemen. Denk aan verplichte risicobeheersystemen en documentatie. Dit komt bovenop de bestaande Arbowet-verplichtingen en geldt voor systemen die beslissingen nemen over mensen.

Hoe ingewikkeld is het om een AI-RI&E op te stellen?

Voor de meeste bedrijven is een gestructureerde checklist van zes stappen al voldoende om een werkbaar beeld van de blootstelling te krijgen. Je hoeft het niet ingewikkeld te maken. Een heldere inventarisatie van welke AI-systemen je gebruikt en welke beslissingen ze nemen is al een solide vertrekpunt.