Risico-inventarisatie en evaluatie voor AI-tools

Ieder bedrijf met personeel is verplicht een risico-inventarisatie en evaluatie (RI&E) op te stellen. Dat staat zo in de Arbowet. Maar die verplichting gaat traditioneel over fysieke gevaren: valrisico's, gevaarlijke stoffen, werkdruk. Wat er ontbreekt in de meeste RI&E's van 2025 en 2026: AI-tools. Terwijl medewerkers dagelijks werken met ChatGPT, Copilot en geautomatiseerde beslissystemen, staat er in het arbobeleid van de meeste bedrijven niets over de risico's die dat met zich meebrengt. Dat is een gat, en het wordt groter naarmate AI dieper in bedrijfsprocessen verankerd raakt.

Belangrijkste punten:

- Een risico-inventarisatie en evaluatie (RI&E) is wettelijk verplicht voor elk bedrijf met personeel, en AI-tools vallen ook onder de risico's die je moet documenteren.

- De EU AI Act introduceert vanaf augustus 2026 nieuwe verplichtingen voor bedrijven die hoog-risico AI-systemen inzetten, met eisen die sterk lijken op een RI&E-aanpak.

- AI-specifieke risico's zoals dataverlies, algoritmische bias en afhankelijkheid van externe systemen vragen om een andere inventarisatiemethode dan fysieke arbeidsrisico's.

- Een AI-RI&E hoeft niet ingewikkeld te zijn: begin met een inventarisatie van welke tools je gebruikt, wie er toegang toe heeft, en welke beslissingen ze ondersteunen of nemen.

Inhoudsopgave

- Wat is een RI&E en waarom geldt die ook voor AI?

- Welke AI-tools vallen onder je RI&E?

- Vier AI-risico's die je moet documenteren

- Hoe voer je een AI-RI&E stap voor stap uit?

- Wat moet je vastleggen voor de AI Act?

- Hoe weeg je AI-risico's af tegen de voordelen?

- De RI&E als startpunt, niet als eindpunt

Wat is een RI&E en waarom geldt die ook voor AI?

Een RI&E is een gestructureerd onderzoek naar alle risico's in je bedrijf die de gezondheid en veiligheid van medewerkers kunnen beïnvloeden. [Volgens de Arbowet](https://www.arboportaal.nl/onderwerpen/arbowet, en, regelgeving/risico-inventarisatie, -evaluatie) moet elk bedrijf met minimaal één medewerker zo'n document hebben, inclusief een plan van aanpak met concrete maatregelen.

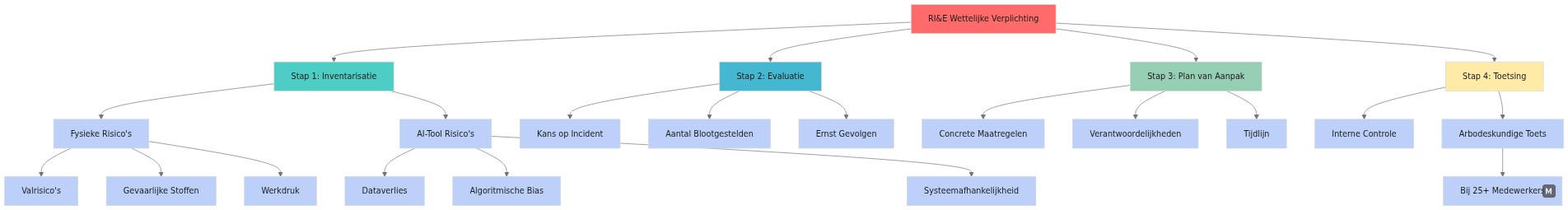

Het klassieke RI&E-proces werkt in vier stappen. Eerst inventariseer je alle risico's. Dan evalueer je ze: hoe groot is de kans dat het misgaat, hoeveel mensen zijn blootgesteld, hoe ernstig zijn de gevolgen? Vervolgens stel je een plan van aanpak op. En tot slot toets je de RI&E, bij bedrijven met meer dan 25 medewerkers verplicht door een gecertificeerde arbodeskundige.

Die structuur is direct toepasbaar op AI. Het verschil zit in de aard van de risico's. Bij een heftruck gaat het om fysiek letsel. Bij een AI-tool die klantcommunicatie afhandelt of personeelsbeslissingen ondersteunt, gaat het om dataverlies, onjuiste uitkomsten, privacyschendingen of juridische aansprakelijkheid. Minder zichtbaar, maar niet minder reëel.

Wat de urgentie vergroot: de EU AI Act treedt gefaseerd in werking. Vanaf 2 augustus 2026 gelden strenge eisen voor hoog-risico AI-systemen, waaronder verplichte risicodocumentatie, logging en menselijk toezicht. Wie dan geen AI-RI&E heeft, loopt niet alleen arborisico maar ook regelgevingsrisico.

Welke AI-tools vallen onder je RI&E?

Niet elke AI-toepassing vraagt om dezelfde aandacht. De EU AI Act hanteert een risicogebaseerde indeling, en die is ook bruikbaar als startpunt voor je eigen inventarisatie.

| Risiconiveau | Voorbeelden | Verplichtingen vanaf aug. 2026 |

|---|---|---|

| Minimaal risico | Spamfilters, tekstsuggesties, voorraadoptimalisatie | Geen specifieke eisen |

| Beperkt risico | Chatbots voor klantenservice, AI-gegenereerde content | Transparantieplicht: gebruikers moeten weten dat ze met AI praten |

| Hoog risico | Recruitment-tools, kredietscoring, biometrische systemen | Risicobeheer, datakwaliteit, logging, menselijk toezicht verplicht |

| Onacceptabel risico | Sociale scoring, manipulatieve AI | Verboden sinds februari 2025 |

Voor de meeste MKB-bedrijven zitten de relevante tools in de eerste twee categorieën. Maar let op: zodra AI een rol speelt bij personeelsselectie, klantbeoordeling of financiële beslissingen, verschuif je richting hoog risico. Een AI-tool die cv's scoort of kredietwaardigheid beoordeelt, valt onder de strenge eisen van de AI Act, ook als je die tool inkoopt bij een externe partij.

Meer achtergrond over hoe AI-systemen met elkaar communiceren en welke beveiligingsrisico's dat introduceert, vind je in het artikel over AI agent protocollen en beveiliging.

Vier AI-risico's die je moet documenteren

De klassieke RI&E kijkt naar kans, ernst en blootstelling. Die drie dimensies werken ook voor AI, maar de risico's zelf zijn anders van aard. Dit zijn de vier hoofdcategorieën die je in een AI-RI&E moet opnemen.

Dataverlies en privacyschendingen. Wanneer medewerkers bedrijfsgevoelige informatie invoeren in een externe AI-tool, verlaat die data mogelijk je organisatie. Denk aan contractteksten die via ChatGPT worden samengevat, of klantgegevens die in een AI-chatbot worden geplakt. De vraag is niet of dit gebeurt, maar hoe vaak en door wie. Dat dit geen theoretisch risico is, bleek in 2024 toen bij Microsoft Copilot een bug werd ontdekt waarbij vertrouwelijkheidslabels op e-mails niet correct werden gerespecteerd, een kwetsbaarheid die zonder actieve inventarisatie onzichtbaar blijft. Lees meer over die casus in het artikel over de Copilot-bug en vertrouwelijke e-mails.

Algoritmische bias. AI-systemen nemen beslissingen op basis van trainingsdata. Als die data historische ongelijkheden bevat, reproduceert het model die ongelijkheden. Stel dat een bedrijf een ML-model inzet voor leninggoedkeuringen: bij een audit zou kunnen blijken dat aanvragers uit bepaalde postcodes systematisch lager scoren, niet op basis van kredietwaardigheid maar door patronen in historische data. Dat type bias is zonder gerichte inventarisatie onzichtbaar. Volgens onderzoek van het RICS (Royal Institution of Chartered Surveyors, 2024) is algoritmische bias in krediet- en vastgoedbeslissingen een van de meest gedocumenteerde AI-risico's in de financiële sector. In een RI&E-context betekent dit: documenteer welke beslissingen AI ondersteunt of neemt, en beschrijf hoe je controleert of die beslissingen eerlijk zijn.

Afhankelijkheid en continuïteit. Wat gebeurt er als een externe AI-dienst uitvalt of zijn tarieven verdubbelt? Bedrijven die hun klantenservice volledig op een AI-platform hebben gebouwd, zijn kwetsbaar als die dienst wegvalt. Dit is een operationeel risico dat thuishoort in je RI&E.

Onjuiste uitkomsten en verantwoordelijkheid. AI maakt fouten. Een juridisch document dat via AI is opgesteld maar niet is gecontroleerd, een financieel advies dat op een hallucination berust, een diagnose-ondersteunend systeem dat een afwijking mist: de verantwoordelijkheid ligt altijd bij de organisatie, niet bij de tool. Documenteer daarom wie verantwoordelijk is voor het controleren van AI-output, en hoe dat is geborgd.

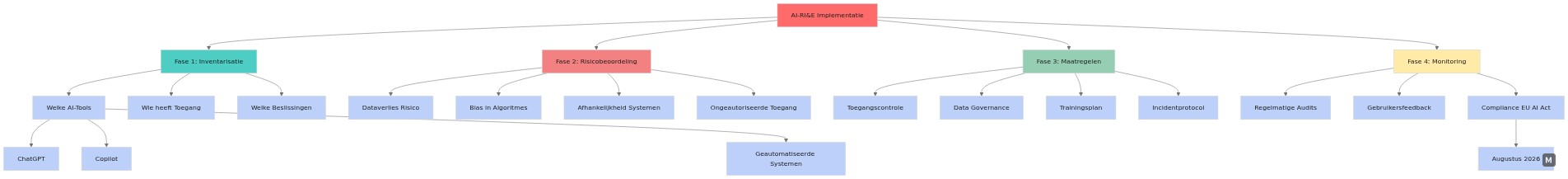

Hoe voer je een AI-RI&E stap voor stap uit?

Het proces volgt de bekende RI&E-structuur, maar met AI-specifieke vragen per stap.

Stap 1: Inventariseer welke AI-tools je gebruikt. Begin met een volledige lijst van alle AI-toepassingen in je organisatie, niet alleen de tools die IT heeft aangeschaft, maar ook wat medewerkers zelf gebruiken. De meeste bedrijven ontdekken hier al de eerste verrassing: tools die IT niet kent, maar die medewerkers dagelijks gebruiken. Vraag per afdeling welke AI-tools er in de praktijk worden ingezet. De uitkomst is vrijwel altijd omvangrijker dan verwacht.

Stap 2: Beschrijf context en gebruik. Per tool wordt duidelijk wie het gebruikt, waarvoor, welke data erin gaat, wat eruit komt, en welke beslissingen erdoor worden beïnvloed of genomen. Dit is de feitelijke basis voor de risicoanalyse, en het moment waarop veel organisaties ontdekken dat medewerkers meer klant- of personeelsdata delen dan het beleid toestaat.

Stap 3: Evalueer de risico's. De klassieke RI&E-formule, kans × ernst × blootstelling, werkt ook hier. Voor AI gaat blootstelling over hoeveel medewerkers de tool gebruiken, hoe frequent, en hoeveel klanten of derden worden geraakt door de output. Ernst gaat over de impact als het misgaat: een fout in een interne samenvatting heeft andere gevolgen dan een fout in een kredietbeoordeling.

Stap 4: Stel maatregelen op. Maatregelen kunnen technisch zijn (toegangscontrole, geen klantdata in externe tools), procedureel (altijd menselijke controle op AI-output in hoog-risico processen) of organisatorisch (beleid over welke tools medewerkers mogen gebruiken). Leg vast wie verantwoordelijk is en wanneer maatregelen worden geïmplementeerd.

Stap 5: Actualiseer regelmatig. Een RI&E is nooit af. Dat geldt voor fysieke risico's, maar zeker voor AI: het toollandschap verandert snel, nieuwe modellen introduceren nieuwe mogelijkheden én nieuwe risico's. Koppel je AI-RI&E aan je reguliere RI&E-cyclus en voeg een trigger toe: elke keer dat je een nieuwe AI-tool introduceert, pas je de inventarisatie aan.

Wat moet je vastleggen voor de AI Act?

Voor bedrijven die hoog-risico AI-systemen inzetten, stelt de EU AI Act concrete documentatie-eisen. Die overlappen sterk met een goede AI-RI&E, maar zijn specifieker.

Verplicht vast te leggen voor hoog-risico AI vanaf augustus 2026:

- Technische documentatie van het systeem en de beoogde toepassing

- Beschrijving van de trainingsdata en datakwaliteitsmaatregelen

- Logging van beslissingen die het systeem neemt of ondersteunt

- Beschrijving van menselijk toezicht: wie controleert, hoe, en wanneer kan een beslissing worden overruled?

- Risicobeheersplan met maatregelen per geïdentificeerd risico

Voor de meeste MKB-bedrijven is het praktisch om dit te integreren in de bestaande RI&E-structuur. Maak een apart hoofdstuk "AI-systemen" in je RI&E-document, met per tool de bovenstaande punten. Dat is tegelijk je arbo-compliance én je AI Act-documentatie.

Bedrijven die AI inzetten voor recruitment moeten extra alert zijn. Recruitment-AI valt expliciet onder de hoog-risico categorie van de AI Act. Een tool die cv's scoort of kandidaten rangschikt, vereist volledige risicodocumentatie, datakwaliteitsborging en aantoonbaar menselijk toezicht op de uiteindelijke beslissing.

Hoe weeg je AI-risico's af tegen de voordelen?

Een RI&E is geen rem op innovatie. Het is een instrument om bewust te beslissen. De vraag is niet "mogen we dit gebruiken?" maar "welke risico's accepteren we, en hoe beheersen we die?"

Dat afwegingskader werkt als volgt. Stel de potentiële schade vast: wat is de ergste uitkomst als dit misgaat, voor medewerkers, klanten en de organisatie? Stel de kans vast: hoe waarschijnlijk is die uitkomst, gegeven hoe de tool wordt gebruikt? En stel de beheersbaarheid vast: zijn er maatregelen die het risico voldoende reduceren?

Een AI-tool voor het samenvatten van interne vergadernotities heeft een laag risicoprofiel. Zelfs als de samenvatting onjuist is, is de schade beperkt en makkelijk te herstellen. Een AI-tool die automatisch betalingen goedkeurt of afwijst, heeft een hoog risicoprofiel. De kans op schade is kleiner, maar de ernst is groter en de beheersbaarheid vraagt om extra maatregelen.

Dit onderscheid helpt ook bij prioritering. Niet alles kan tegelijk worden aangepakt. Begin met de tools die de hoogste combinatie van kans en ernst scoren, en werk van daaruit.

Voor organisaties die AI-agents inzetten, tools die zelfstandig acties uitvoeren in systemen, is de risicoafweging complexer. Zie ook het artikel over AI agent beveiliging voor concrete voorbeelden van wat er mis kan gaan als AI-agents te veel autonomie krijgen zonder adequate controles.

De RI&E als startpunt, niet als eindpunt

De meeste bedrijven die AI serieus inzetten, ontdekken tijdens een AI-RI&E dat ze meer tools gebruiken dan ze dachten, dat medewerkers meer data delen dan beleid toestaat, en dat verantwoordelijkheden voor AI-output nergens zijn vastgelegd. Dat is geen aanklacht, dat is de realiteit van hoe AI de afgelopen jaren de werkvloer is binnengedrongen: snel, informeel, en zonder bijbehorend beleid.

Een risico-inventarisatie en evaluatie dwingt je die realiteit te documenteren. Niet om alles te verbieden, maar om bewuste keuzes te maken. Welke tools zijn acceptabel? Onder welke voorwaarden? Wie is verantwoordelijk als het misgaat? Die vragen beantwoorden is de kern van goed AI-beleid, en de RI&E is de structuur om dat te doen.

De Nederlandse Arbeidsinspectie controleert al of RI&E's volledig zijn. Naarmate AI-gebruik toeneemt en de AI Act verder in werking treedt, is het een kwestie van tijd voordat toez

Veelgestelde vragen

Is een RI&E verplicht als je medewerkers AI-tools laat gebruiken?

Ja. De Arbowet verplicht elk bedrijf met personeel een RI&E op te stellen voor alle risico's die medewerkers kunnen raken. AI-tools zoals ChatGPT of Copilot vallen daar ook onder, ook al staat dat in de meeste bestaande RI&E's nog niet.

Wat is de RI&E betekenis in de context van AI?

Een RI&E (risico-inventarisatie en evaluatie) is een gestructureerd onderzoek naar risico's voor gezondheid en veiligheid op de werkvloer. Bij AI gaat het niet om fysiek letsel, maar om risico's zoals dataverlies, algoritmische bias en afhankelijkheid van externe systemen.

Hoe stel je een RI&E op voor AI-tools?

Begin met een inventarisatie van welke AI-tools je gebruikt, wie er toegang toe heeft en welke beslissingen ze ondersteunen of nemen. Evalueer daarna kans, blootstelling en ernst van mogelijke fouten. Leg dit vast in een plan van aanpak.

Wat verandert de EU AI Act aan de RI&E-verplichting?

Vanaf augustus 2026 introduceert de EU AI Act nieuwe verplichtingen voor bedrijven die hoog-risico AI-systemen inzetten. Die eisen lijken sterk op een RI&E-aanpak: documenteer risico's, tref maatregelen en leg verantwoording af.